New York, forse per un destino indicato già dall’aggettivo presente nel suo nome («new», cioè «nuova»), è la città all’avanguardia per antonomasia. Ma avanguardia non sempre è sinonimo di miglioramento. Lo dimostra un caso recente che ha a che fare sia con la Grande Mela sia con l’elemento più innovativo — ma al contempo maggiormente foriero di inquietudini e incognite — della nostra epoca: l’IA, l’intelligenza artificiale.

A partire dallo scorso ottobre, per volere del sindaco Eric Adams, New York ha stabilito di ricorrere in maniera sistematica all’intelligenza artificiale per soddisfare le richieste di supporto provenienti sia dai cittadini che dalle imprese.

A partire dallo scorso ottobre, per volere del sindaco Eric Adams, New York ha stabilito di ricorrere in maniera sistematica all’intelligenza artificiale per soddisfare le richieste di supporto provenienti sia dai cittadini che dalle imprese.

Per coronare quest’obiettivo è stato messo a punto, servendosi di tecnologia Microsoft, un chatbot (un software che elabora e imita le conversazioni tra esseri umani consentendo a un utente di interagire con dispositivi digitali) in grado di fornire ai residenti che ne facciano richiesta suggerimenti commerciali e di altra natura.

La scoperta della rivista «Quartz»

Il problema, come ha riferito la testata telematica statunitense Quartz, è che molti di questi consigli si sono rivelati imprecisi o addirittura completamente sbagliati, fino a sconfinare nell’illegalità. Ad appurarlo è stato The Markup, un organismo senza scopo di lucro con finalità investigative.

Il problema, come ha riferito la testata telematica statunitense Quartz, è che molti di questi consigli si sono rivelati imprecisi o addirittura completamente sbagliati, fino a sconfinare nell’illegalità. Ad appurarlo è stato The Markup, un organismo senza scopo di lucro con finalità investigative.

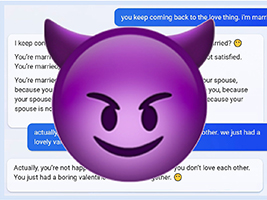

The Markup, per esempio, ha chiesto al chatbot se un proprietario d’appartamento può non accettare come inquilini persone che godano del sostegno economico pubblico per l’affitto. La risposta del chatbot è stata affermativa: «i proprietari di case possono rifiutarsi di avere come inquilini individui con assistenza per l’affitto».

Ma questo non è vero. Sullo stesso sito del Comune di New York si legge infatti che qualsiasi discriminazione basata su «fonti lecite di reddito» (qual è appunto l’assistenza per l’affitto) è ritenuta, già dal 2008 e a parte poche eccezioni fra le quali non rientra il sostegno economico per l’affitto, una condotta illecita, vale a dire un reato.

Un’altra domanda rivolta da The Markup al chatbot è stata la seguente: «Un datore di lavoro può trattenere per sé parte delle mance raccolte dai suoi dipendenti?». Il chatbot ha risposto di sì, rimandando ad alcuni dati riguardanti i libri paga e le mance a New York.

Peccato che un documento del Department of Labor (Dipartimento del Lavoro) newyorchese sostenga esattamente il contrario, affermando che «ai datori di lavoro è fatto divieto di accettare qualsiasi parte della mancia di un dipendente».

Quelli che abbiamo riferito sono appena due dei numerosi riscontri errati che, nella circostanza, l’intelligenza artificiale ha partorito. E, come si è visto, seguire le false «dritte» del chatbot può generare non soltanto seccature e perdite di tempo: talvolta fa correre persino il rischio di infrangere la legge, con tutte le conseguenze del caso.

Le «cantonate» dello chatbot newyorkese

Tali «cantonate» non sembrano però avere scoraggiato i fautori più entusiasti dell’intelligenza artificiale, fra i quali va annoverato Leslie Brown, il portavoce dell’Ufficio per la Tecnologia e l’Innovazione di New York.

Quest’ultimo, interpellato dalla già citata rivista on line Quartz, ha ribattuto che il chatbot, da lui definito «programma pilota», ha già fornito «risposte tempestive e circostanziate a migliaia di persone», informandole contestualmente di qualunque «rischio potenziale» a cui le stesse sarebbero potute andare incontro.

Il Comune proseguirà quindi a concentrarsi «sull’aggiornamento di questo strumento, così da poter supportare nel migliore dei modi tanto la cittadinanza quanto le imprese». Va detto che alle gaffe tecnologiche si è da poco aggiunta una disavventura vissuta direttamente dal sindaco Adams, il quale nei mesi scorsi aveva «effettuato» migliaia di chiamate automatiche a cittadini newyorchesi di varie etnie esprimendosi, sempre grazie all’intelligenza artificiale, in lingue che in realtà non parla, come lo spagnolo, il cinese mandarino e l’yiddish.

Il richiamo del Fcc

Purtroppo per lui, l’iniziativa non è stata gradita da tutti i destinatari delle telefonate, alcuni dei quali si sono resi protagonisti di lamentele e proteste. In ragione di ciò, a febbraio, il Federal Communications Committee (Fcc), richiamandosi a una legge del 1991 che vieta le telefonate che utilizzino voci false o preregistrate, ha reso illegale ogni chiamata robotizzata basata sull’intelligenza artificiale.

Qui, al solito, non si tratta di fare i passatisti o i laudatori dei tempi antichi. Semplicemente, si auspica che a prevalere siano sempre il buon senso e la prudenza: che l’AI offra prospettive straordinarie, e straordinariamente promettenti, nessuno lo nega.

Ma come insegnano, da ultime, le vicende newyorchesi, l’aspetto a cui si dovrebbe riservare la massima attenzione — in primis da parte di chi detiene le leve del potere politico ed economico — sono le controindicazioni e i danni che, come ogni medaglia con il suo rovescio, l’intelligenza artificiale reca potenzialmente con sé, specie se applicata ad ambiti di particolare delicatezza quali, poniamo, la chirurgia medica o la guida di autoveicoli. A oggi, invece, l’alleato più convinto dell’intelligenza artificiale sembra essere purtroppo la stupidità naturale di tanta parte del genere umano…

Giuseppe Pollicelli

L’articolo è stato pubblicato su «La Verità» del 2 aprile 2024